OS17でObject Captureというのができるらしい

どこでできるんだ!!って思ったらその機能を入れているサードパーティーのアプリでやる必要がある

少し勘違いしている人がいたので補足

— iwama@iPhoneで3Dスキャンする人 (@iwamah1) 2023年9月18日

ObjectCapture for iOS自体はAppleが無料公開しているAPIになります

なのでiOS17.0にアップデートしても標準アプリで実装はされていないので注意(動画でKIRI engineを使用しているのもそれが理由) https://t.co/9Fpv8MkYOh

Hyper Capture

最初に試したのはこちら。

iOS17のリリースと同時に出たObject Captureアプリ

— Satoshi Kimura (@toecheese) 2023年9月18日

「Hyper Capture」

すぐに3Dキャプチャーを試してみたい人におすすめ#objectcapture #ios17 #iPhone #新機能 pic.twitter.com/Vm2LBwDb0J

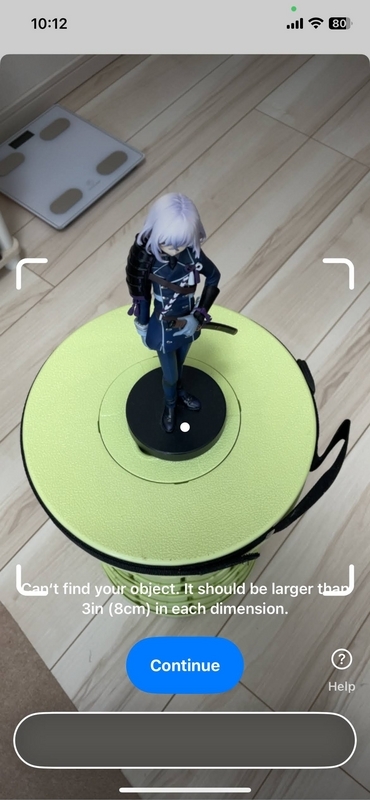

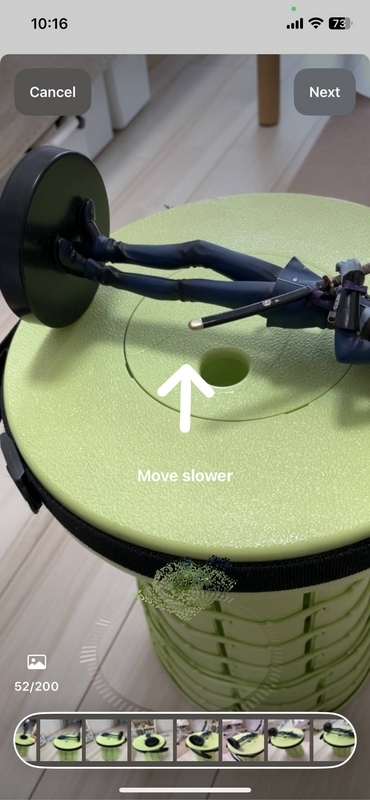

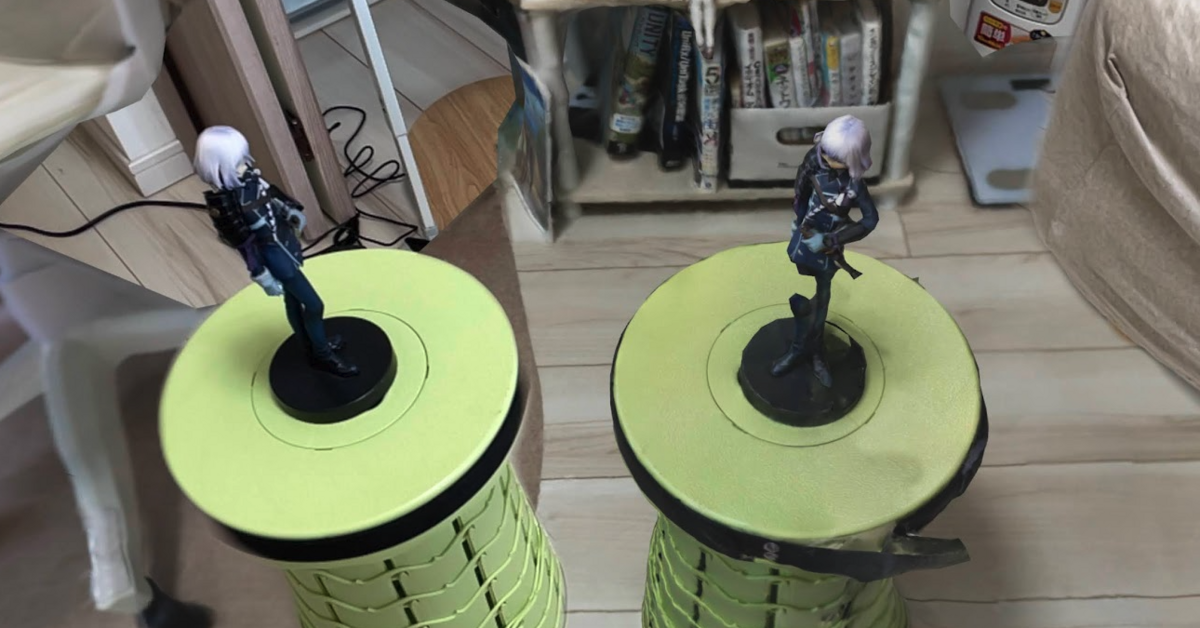

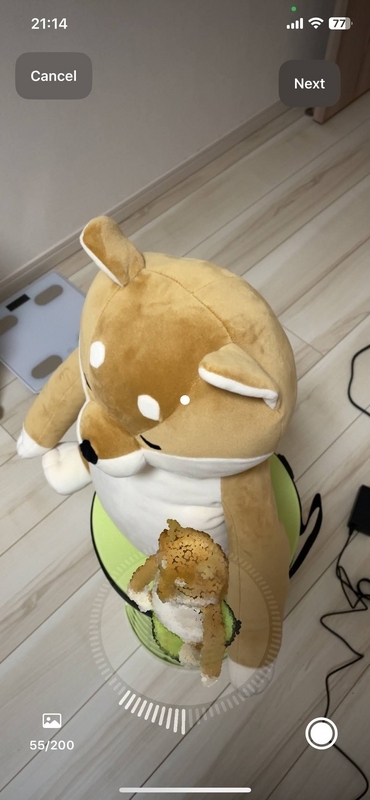

360度周りから撮影できる環境を作るのって難しいよね。折りたたみ丸椅子が便利

最初に適当にフレームに入れる

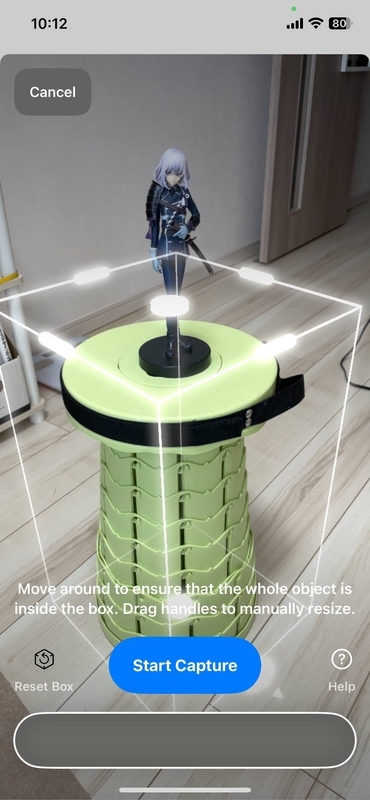

そしたら推定でこの範囲か?って直方体が出てくるので違うよ〜って修正する

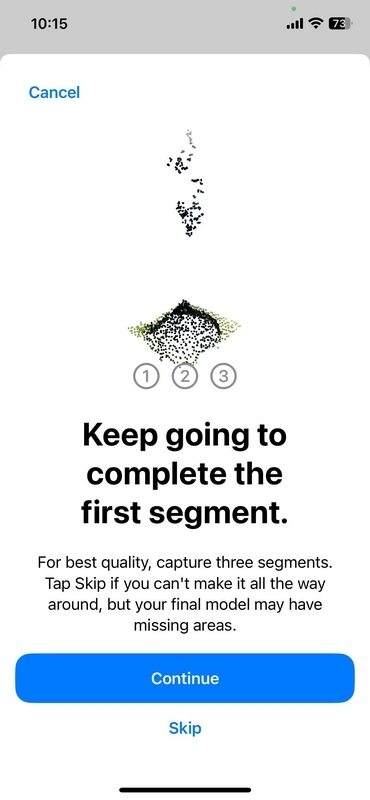

そのあとひたすら回っていく。下の白い線を埋めるようにする必要がある

ちゃんと全部埋めろって怒られてる気がする

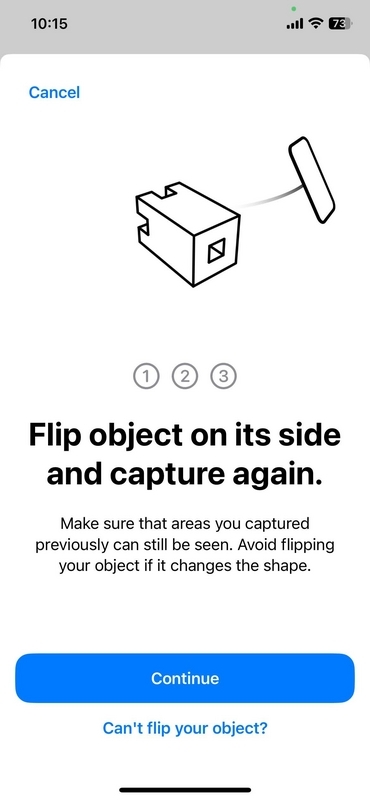

これ横に倒せって意味で合ってる?

この矢印の意味が最初わからなかったけど、画面真ん中にオブジェクトを映せっていう意味だった。

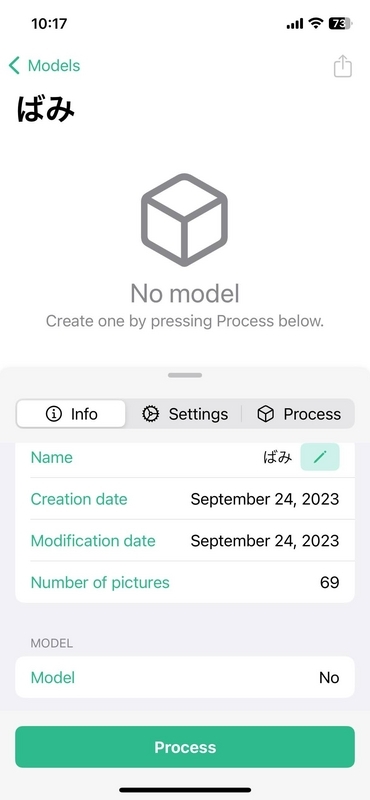

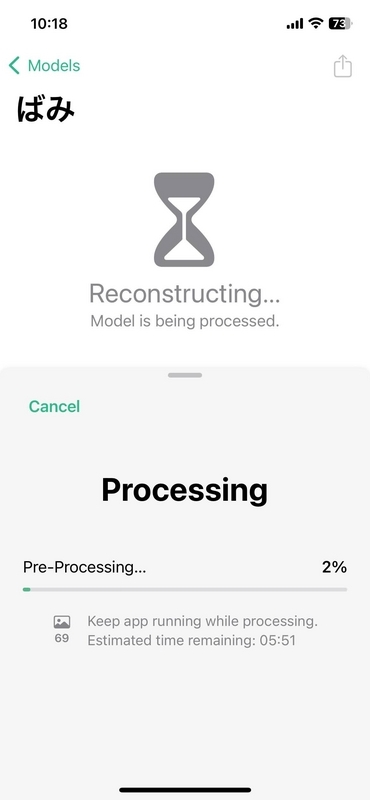

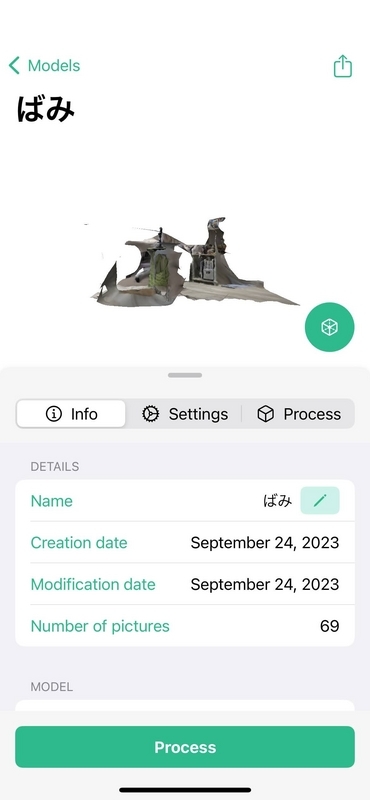

できたのでProcessを押す

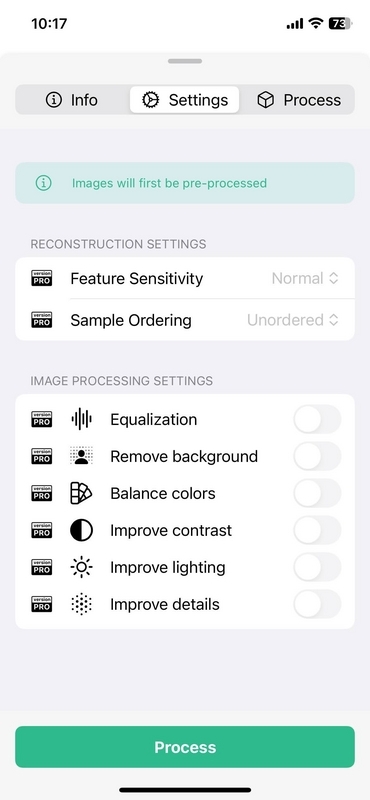

PRO版だと色々調整できるっぽい

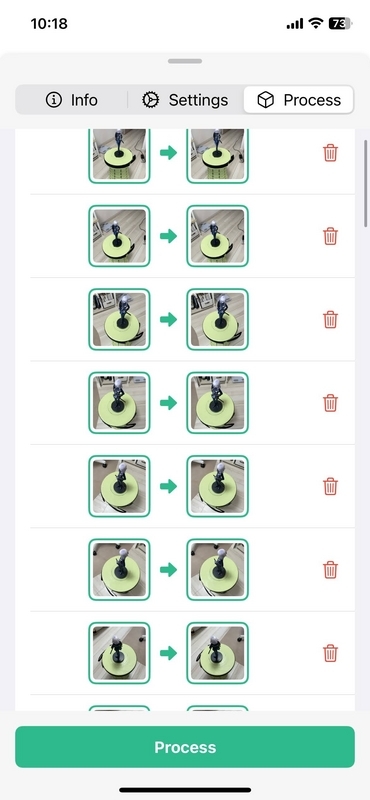

Proxessタブはよくわからない。ノイズになる写真を消せるのかな?

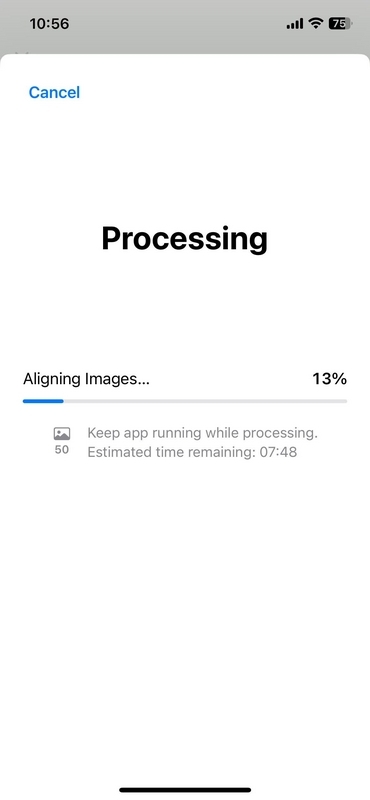

10分ぐらいかかったかな〜

え?

な対象オブジェクトだけじゃなくて周りの景色も入っちゃった・・・ちゃんと最初に範囲設定したはずなのに。

クロップする場所があるのかと思ったけどないし。

何がARで何が実写かよくわからない世界になった。そういうアートかな?

KiriEngine

次にこっちを試した。こっちのほうがよさげ

iOS17で使用可能になるiPhone3Dスキャン機能『Object Capture for iOS』を試してきた

— iwama@iPhoneで3Dスキャンする人 (@iwamah1) 2023年9月16日

OC for iOS自体はAppleが無料公開しているAPIなのでどのアプリにも組み込めるのが特徴… pic.twitter.com/1S7Wphm5ib

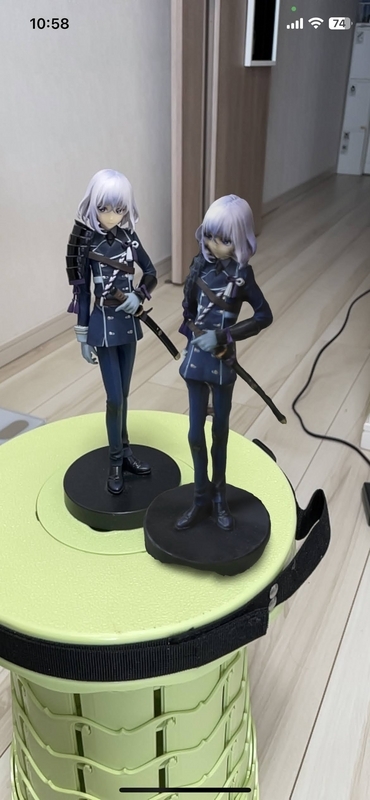

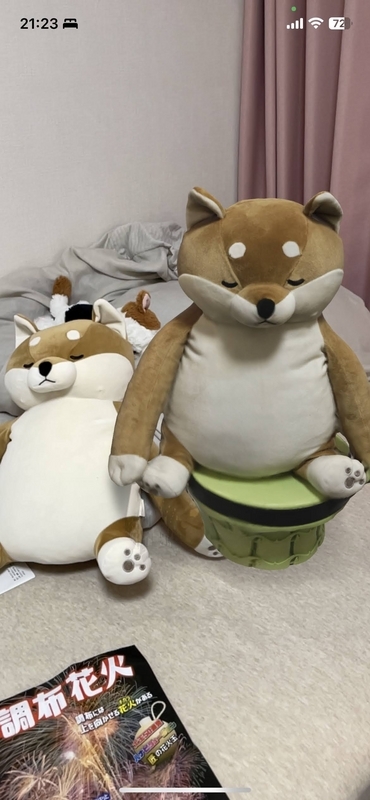

iPhone15ProMaxというLiDARをゲットしたので、KIRI Engineを使ってObject Capture for iOSをお試し!!!

— そいちろ (@asidys230) 2023年9月22日

手軽だし品質も良いし、iOS端末ローカルで処理が完結するのもめっちゃイイ!! pic.twitter.com/ILxZlDv3UN

KiriEngineっていう名前は初めて聞いたけどなんかすごいらしい

3Dスキャン泣かせの黒くてツルテカなリモコンでテストしてみたけど…KIRI EngineのNSRを利用したベータ機能が圧倒的に良い。これは革命だわ。

— モジョン (@mojon1) 2023年9月23日

世間じゃiOS17のObject Capture APIが話題だけど、個人的にはそれよりNSR(Neural Surface Reconstruction)の性能に驚いてる。#KIRIEngine #NeRF #3DScan pic.twitter.com/DkpcNcqgFc

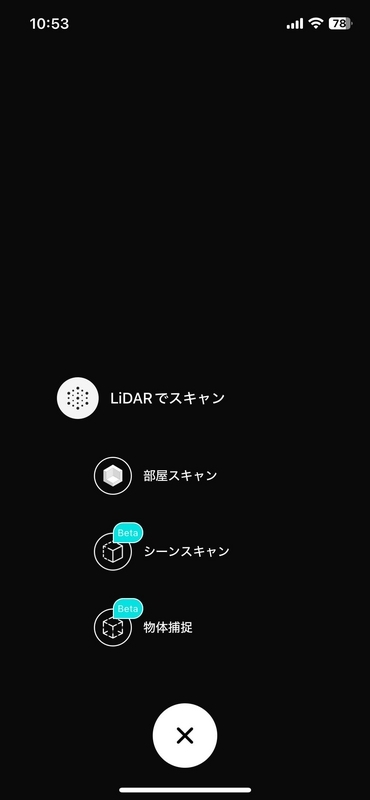

物体捕捉というのを選ぶ。アカウント作成とかもいらない

一発で綺麗に囲んでくれた!!すっご

あとは同じようにやっていく。その部分のUIはHyper Captureとだいたい一緒。API部分なのかサンプルなのかよくわからないが

ProcessingのとこはUI違う

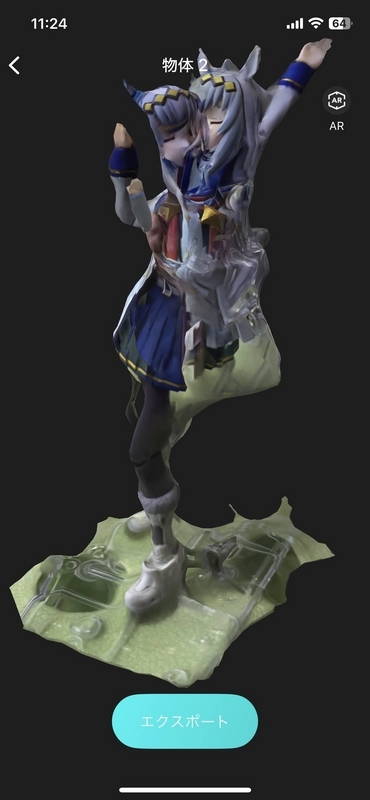

適当にやったら顔が崩れちゃった;;

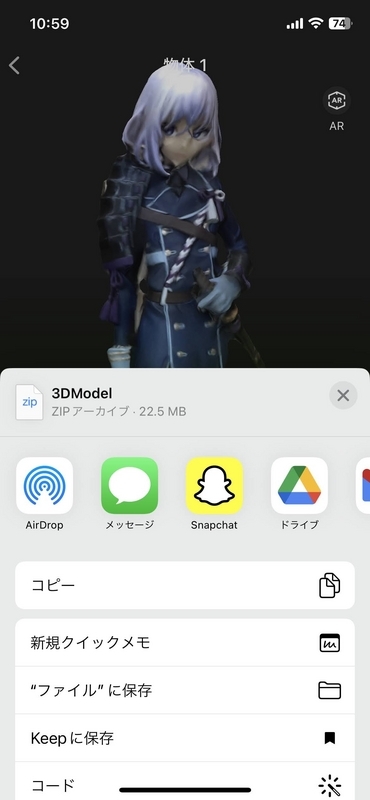

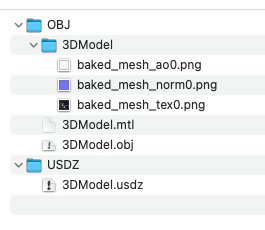

書き出しも無料でできるの!?

PCに送った。

なんとOBJとUSDZが両方入ってる!!!!神か?

おお〜〜

もう1回今度はちゃんとスキャンしよう!って思ってやったらこんなことになった;;

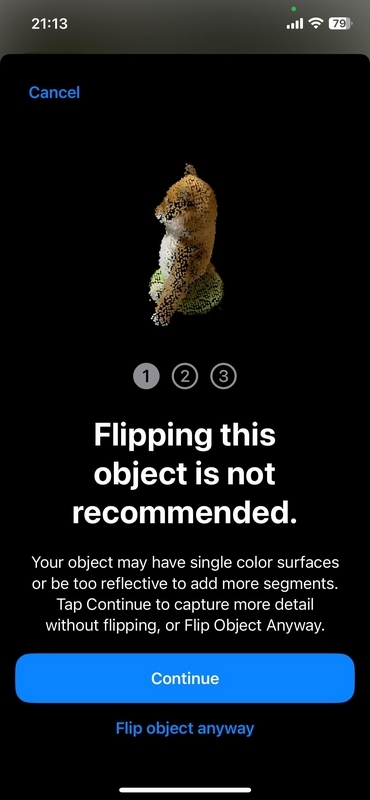

横に倒してスキャンしてくださいっていうUIが出たと思ったから横に倒したんだけど、それがいけなかったのか?

別の人形でやったら初めて出るUIが。同一色すぎるからうまく行かないかもてきなことか?

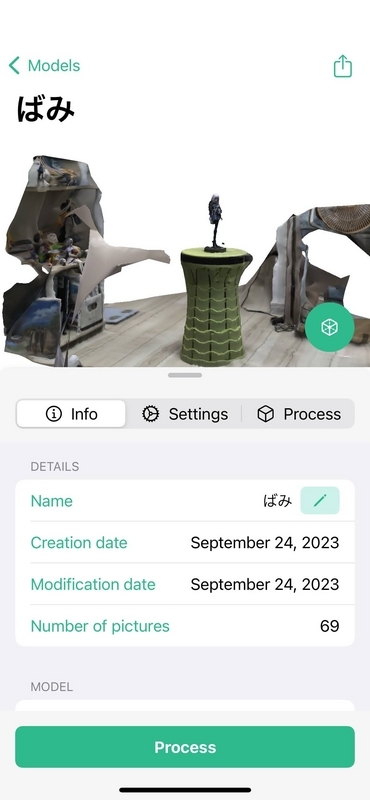

大きめのものの方が上手くやりやすい気がする。これは初めてパーフェクトスキャンした

じゃ〜ん!完璧〜

最初のワイヤーの範囲の時にひよって底辺部分の位置を低めにしてたので椅子も入っちゃったが。

あとからクロップする機能はないのかな?パッと見た感じなさそう。

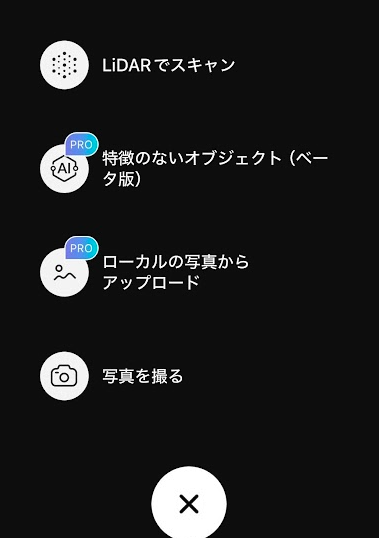

ちなみにNerfは「特徴のないオブジェクト」ってモードかな?AIって書いてるし

PRO版じゃないと使えない

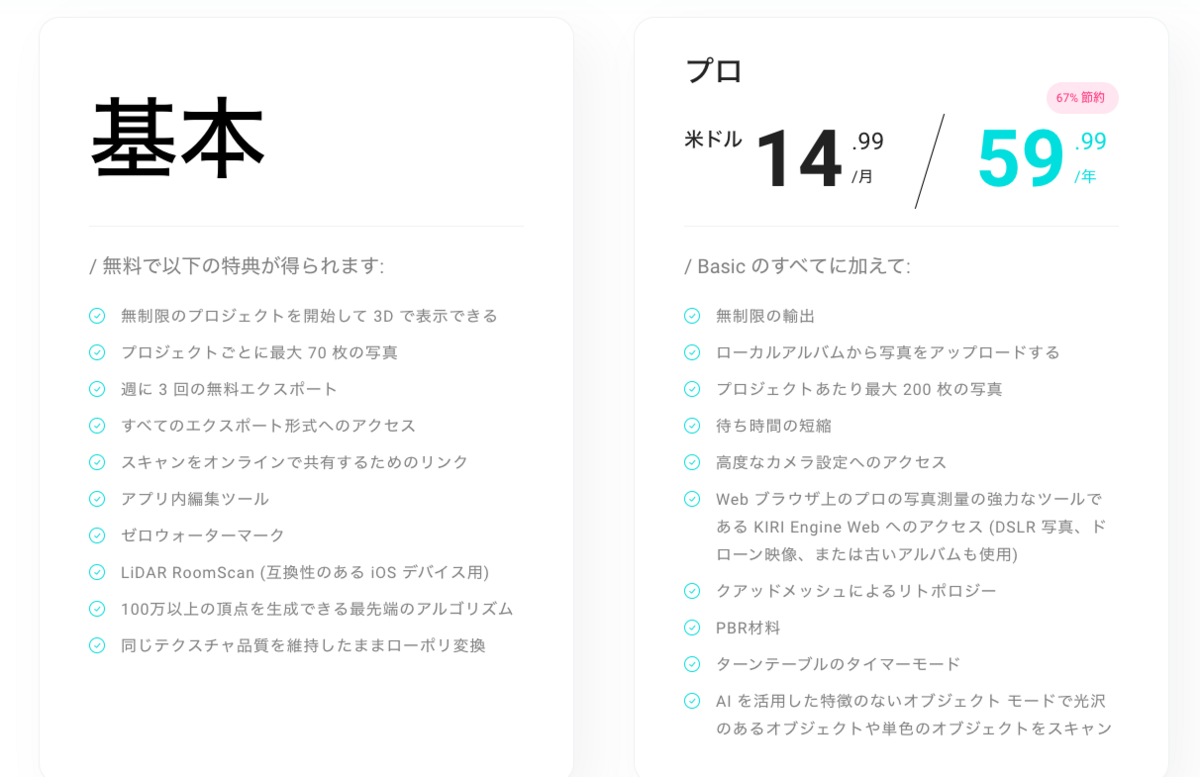

無料版とProの違い

無料の場合週に3つまでエクスポートできるらしい。太っ腹

RoonPlanも使える

自分でビルド

ヒロムさんにObjectCapture for iOSのサンプルを教えてもらったので、ビルドとテスト。

— 中村 薫 (@kaorun55) 2023年9月20日

やっと使い方が分かったので4倍速の動画。

画面下の丸い部分が全て埋まるようにスキャンすると処理が進んでいく。https://t.co/YYb75QeBgW pic.twitter.com/idvZU5oace

iPhone15 Proで早速スキャンを試す。

— 龍 lilea (@lileaLab) 2023年9月23日

ハチ公をARコピペ出来たわ。

iOS17から使えるようになったObject Capture for iOSのサンプルアプリ↓https://t.co/JbA388004v pic.twitter.com/O1TBETSiJ3

ObjectCaptureとは

結局ObjectCaptureとはなんなんだろう?

LiDARを使ったスキャンは今までサードパーティーのアプリの機能であったけど、そういう技術をAppleが公式でAPIにした感じなのか?

何にしても公式のAPIがあるとアプリに組み込みやすくていいね!

私も新規事業でスキャンを使ったアイデアを考えてたけど、実際自分でアプリを作るとなったらどうやってスキャンの技術を取り込むか悩んでたもんな〜

LumaAIとかが料金表みたいなのだしてたからそれとかかな〜って軽く思ってた。

誰かがそういう組み込めるAPI一覧みたいなツイートしてたけど見つけられない・・・

あった!!

アプリ組み込み可能なスマホ向け3Dスキャンサービスについての考察

— iwama@iPhoneで3Dスキャンする人 (@iwamah1) 2023年9月17日

現状選択肢にあるのが

①ObjectCapture(Apple)

②ObjectCapture for iOs(Apple)

③Niantic Scanning Framework(Niantic)

これら3つは各メーカーからAPI等が無料で公開されている

その上で各サービスの特徴… https://t.co/9Fpv8MkYOh

ObjectCaptureとObjectCapture for iOSがあるのか?

①はこれか。Mac用

この記事に経緯書いてた

実際この機能を使っている実践的なアプリがもう出てる。

おまけ

あんまり関係ないけど、これいいなって思った

真上から撮りにくい写真をiPhone LiDAR で撮ってる pic.twitter.com/S5nkds7ZCj

— ミクミンP/Kazuhiro Sasao (@ksasao) 2023年9月17日