こちらの記事で紹介されていたものを参考に色々します。

Xcodeサンプル

公式からxcodeで作ったサンプルが配布されているので、ビルドしてやってみました。

ARKit | Apple Developer Documentation

このページの{}マークがついているリンクから3つダウンロードできる。

Building Your First AR Experience

平面認識のサンプル。最初に左下にカメラを動かしてくださいみたいなメッセージが出る。そこらへんをUXの参考にしてねってことだと思います。

Handling 3D Interaction and UI Controls in Augmented Reality

椅子やカップなどの3Dオブジェクトを床に置くサンプル。ライティングがすごく綺麗!

モデルのマテリアルや影の付け方、環境光推定などすごく参考になります。

カメラを動かすとハイライトも変わる

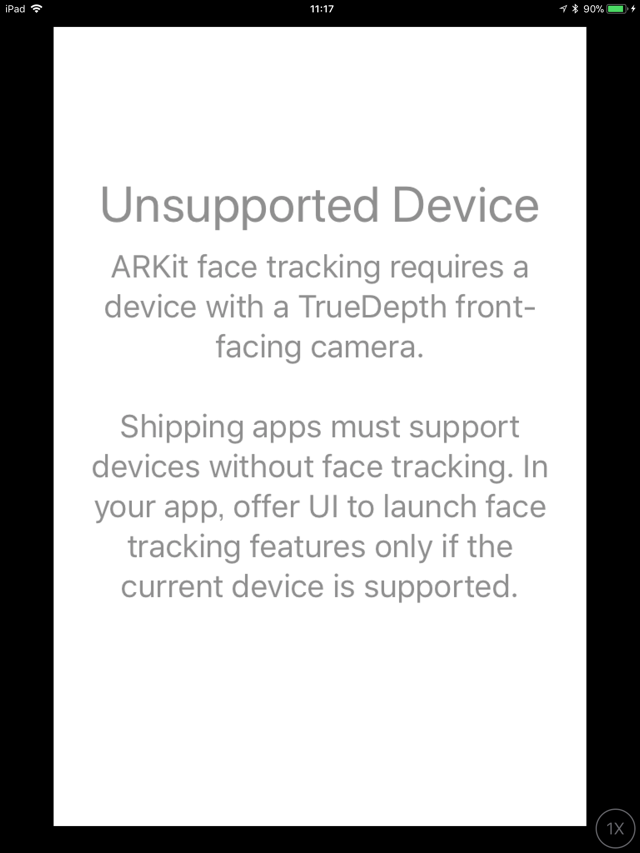

Creating Face-Based AR Experiences

iphoneXでのみ動くサンプルだった・・・

そうとも知らずビルドしたら「Depthセンサーがついてるやつだけで動くよ」って言われた。

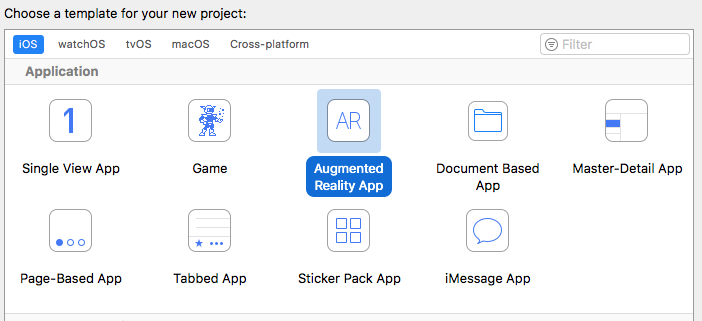

デフォルトテンプレート

Xcodeでプロジェクトを作る時のテンプレートでARをマークを選んでそのままビルドする

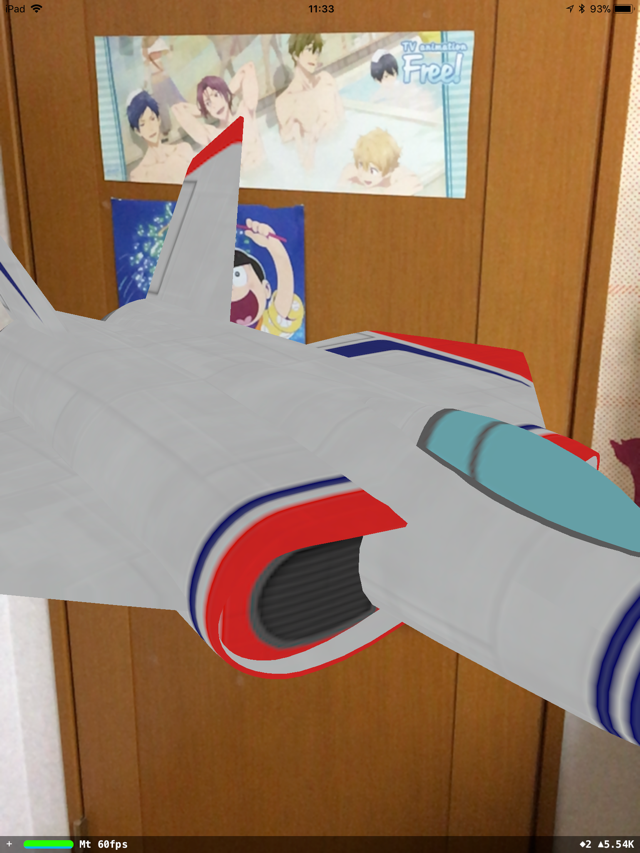

飛行機が空中に表示されました。

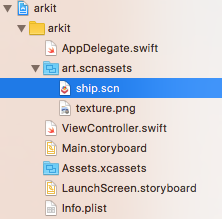

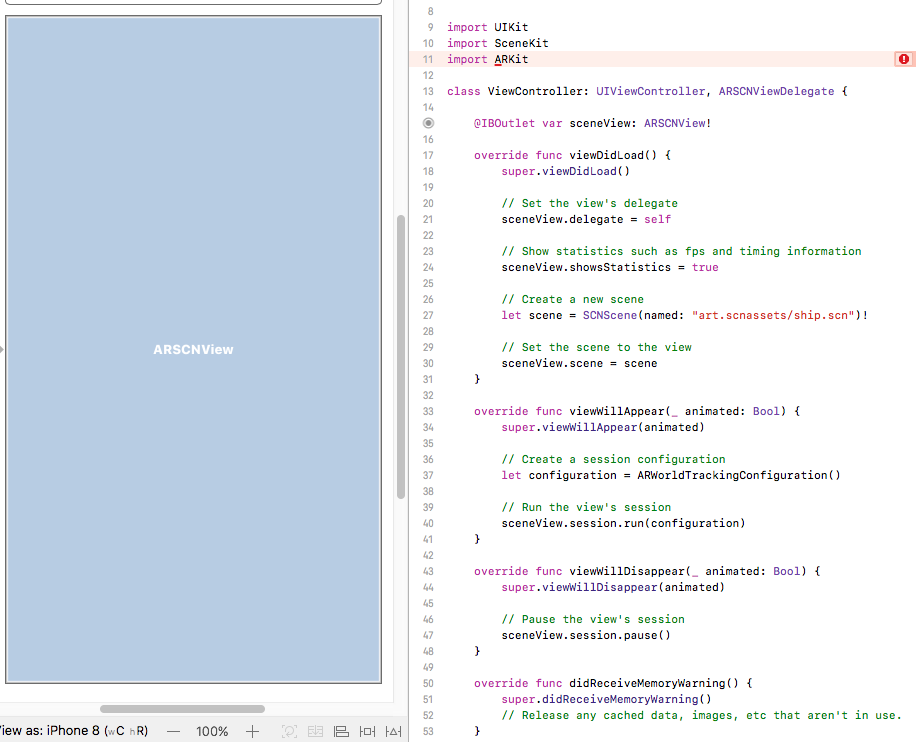

プロジェクトの中身を見てみると、こんな感じです。

モデルがsnc形式という見慣れないものだったのですが、調べたらdaeファイルをscnassetsの下に入れたら.scnになるらしい。

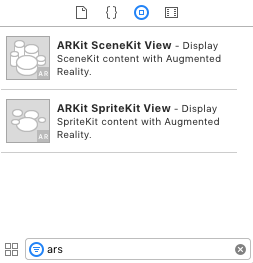

AR関係の部品としてはこんなのがあった。

これをMain.storyboardのviewにドラッグしたら下みたいになる。そしてコードを書いている

普段はunityで作っているけどxcodeでもできるんですね

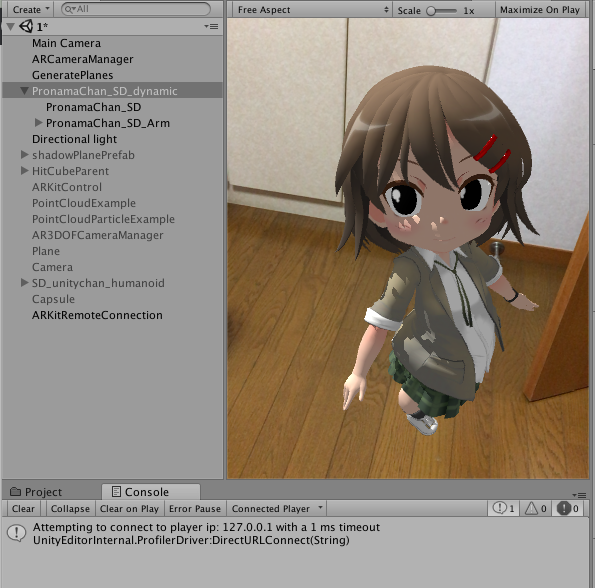

Unityエディタでリモート動作確認

unityのエディタ上で実機のリモートテストができるらしい!

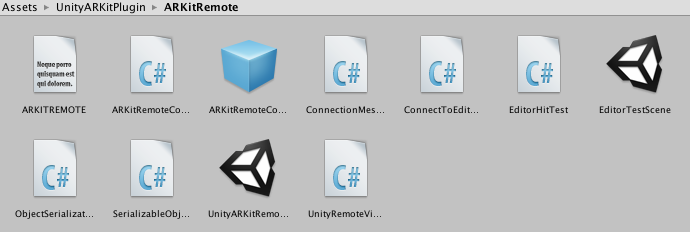

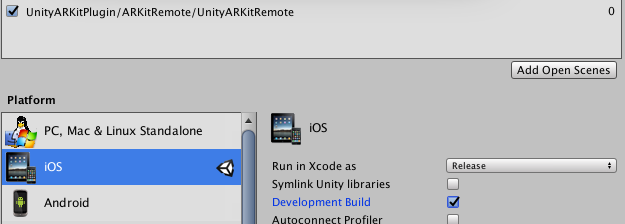

まずSDKサンプルの中のARkitRemoteの中のUnityARkitRemoteシーンをビルドして実機にインストールする。

その際Development Buildにチェックを入れないといけない。

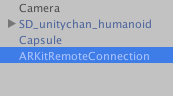

実機の準備ができたら、実行したいシーンにARkitRemoteConnectionプレハブを置くだけ!

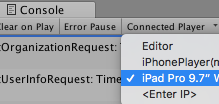

そしてそのシーンを実行した状態で、ConsoleのConnected Playerから実機を選んで、

connectedされると、(Start~ボタンを押す?)

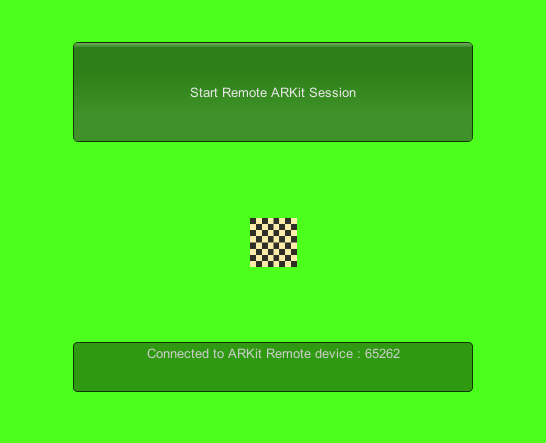

スッゲーでた!実機のカメラに写っているカメラからの画像がunityのエディタに表示されました!!めっちゃ感動する。

ちなみに実機側には何も表示されない。タッチなどの操作もエディタ側でクリックすることでできる。

たぶん環境光とか平面推定とか全ての動作がエディタ上でできている。

これでいちいちビルドしてXcode開いて〜っていう操作が必要なくなる!!!!

UIとかUXについて

About Augmented Reality and ARKit | Apple Developer Documentation

Augmented Reality - Technologies - iOS Human Interface Guidelines

図解付きで説明がある。英語だけど

また下のページにはUIのダウンロードリンクがある。

https://developer.apple.com/design/resources/#ios-apps

最後に

とても勉強になる記事でした。

実際に誰かに体験してもらうアプリを作る際に気をつけるべきUIやUXについても触れてあったので、いつかちゃんとしたものを作る時に参考にしたいと思います。