こちらのOculusのHandTrackingの動画を見てメモします。英語なので1割ぐらいしか理解してない

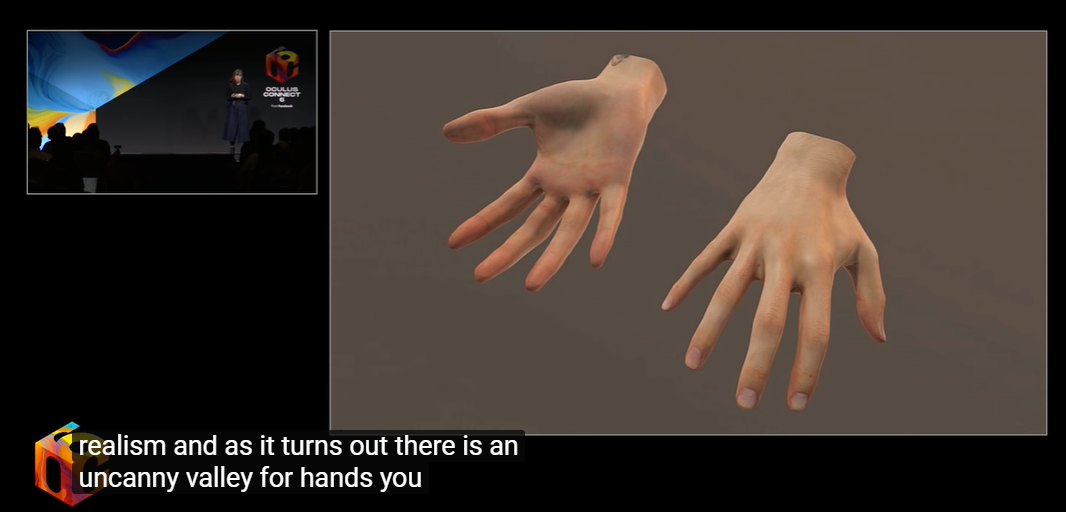

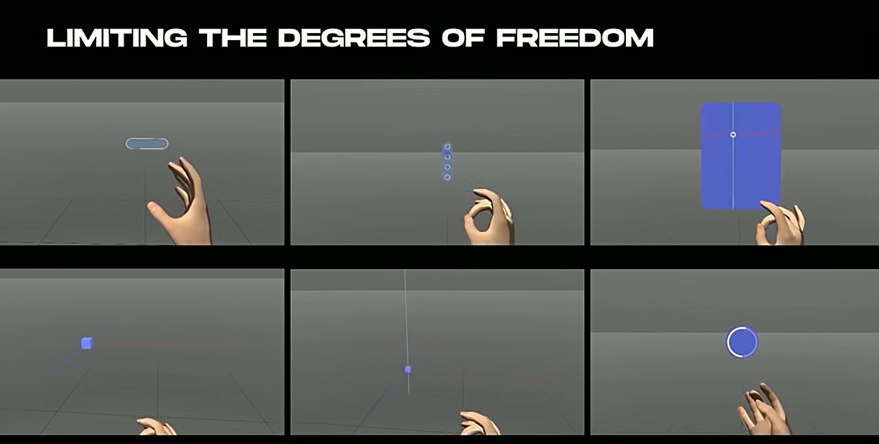

HandModelについて

手はUnconstrained=制約なし

いろいろなハンドモデルを試した

non humanの手はToolのように感じられてしまう。

リアルな手はuncanny valley=不気味の谷

クリーチャーの手も試した

結局少し透明な普通の手にした。

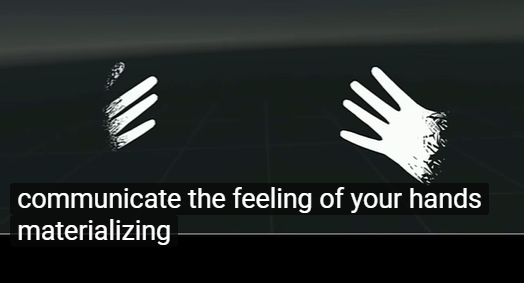

トラッキング範囲外から消えるときの表現もいろいろ試した。

パーティクルや

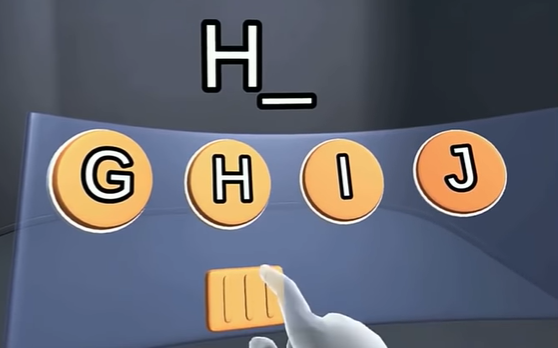

こんな感じ

グリッドの表示?

結局シンプルに透明にしていくようにした。

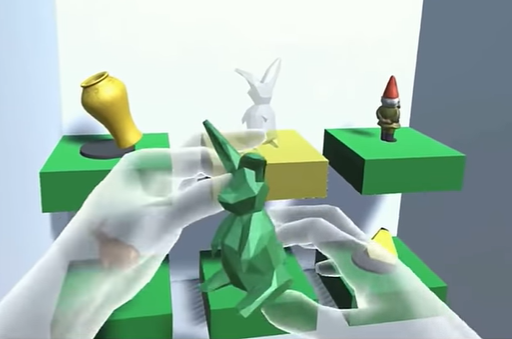

物をつかんで両手で向きを変えて、指定の場所に置く

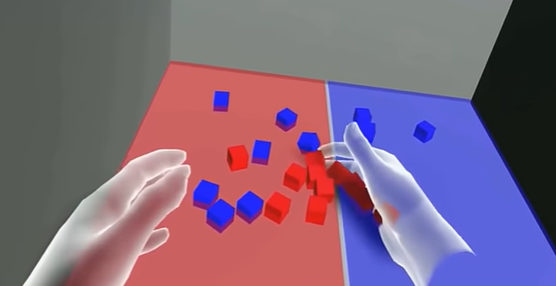

赤と青のブロックを分けた

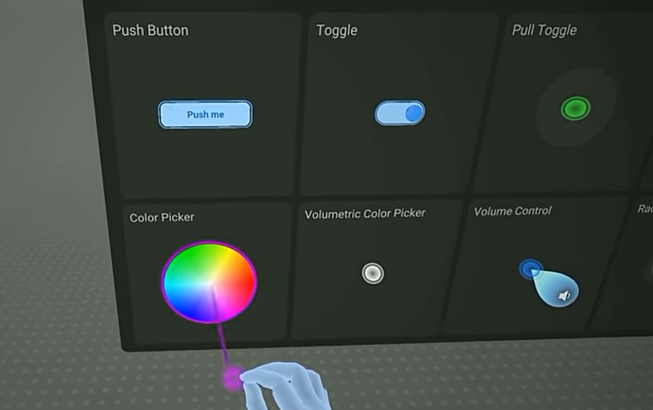

ボタン押したり、スライダーを動かしたりした

数ある中からいいものを選んだ

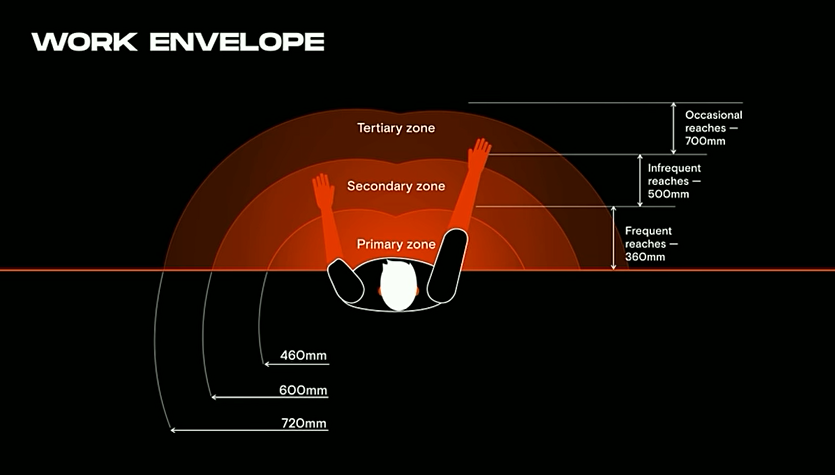

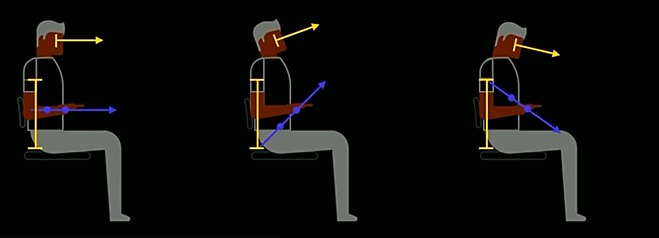

DESIGNING HAND INPUT

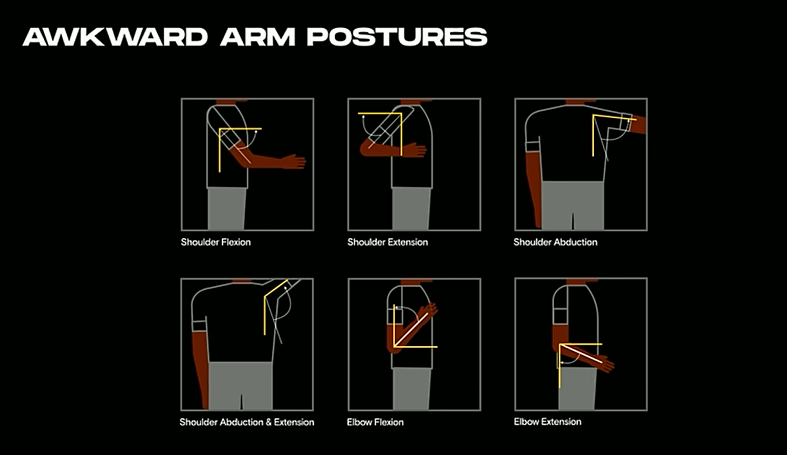

awkward arm position=ぎこちない腕の位置

上の図の角度から、矢印の方向に行くと腕がきつくなってしまう。

(実際に試したら確かにってなった!)

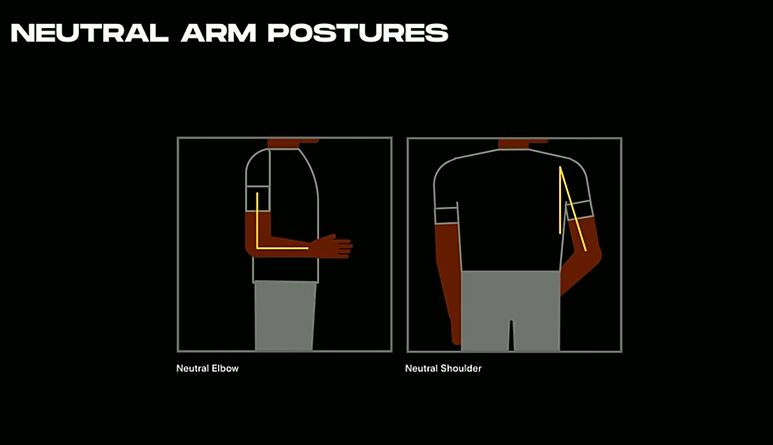

自然なポジションは↓

架空のボタン押すときに届く範囲?近いほうがいいのかな?

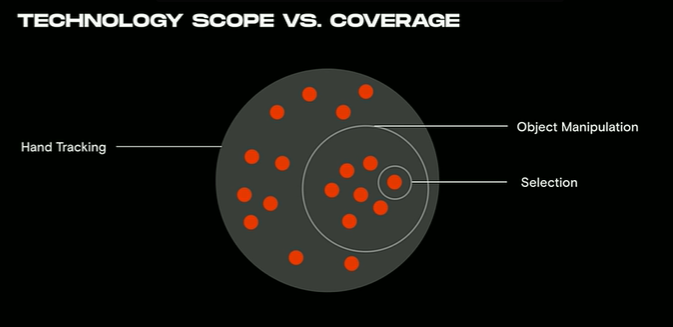

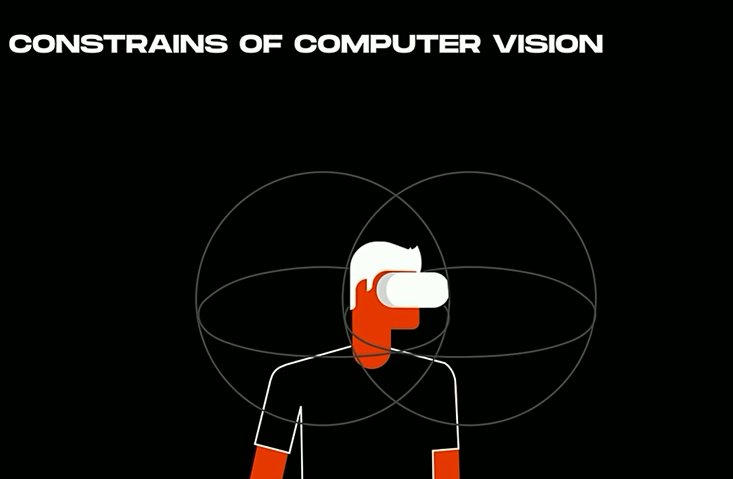

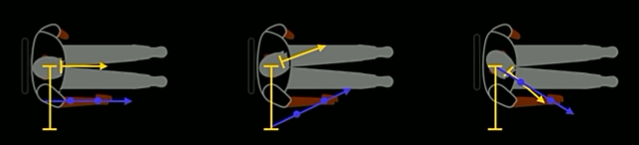

constrains of computer vision=コンピュータビジョンの制約

よくわからないけど、HMDについているカメラのトラッキングの範囲を示している?

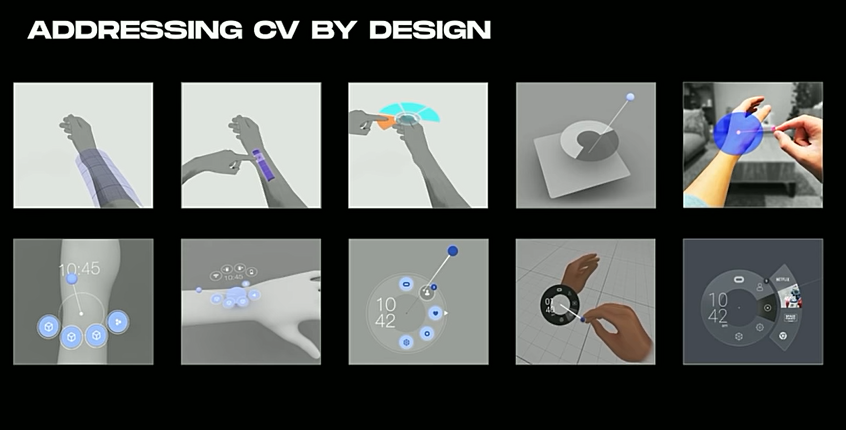

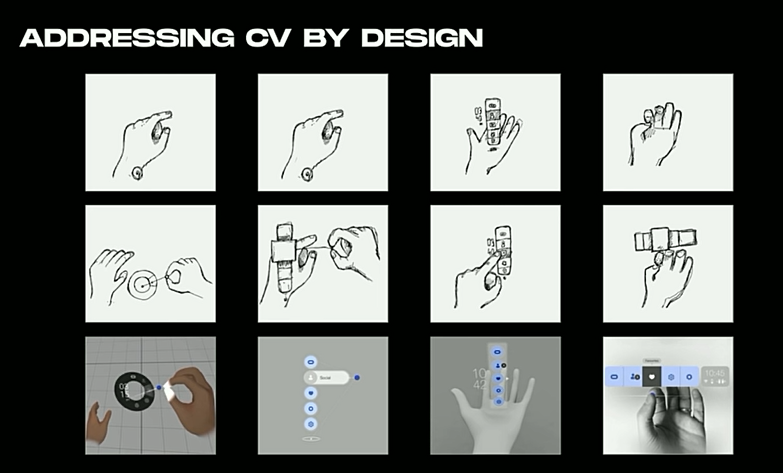

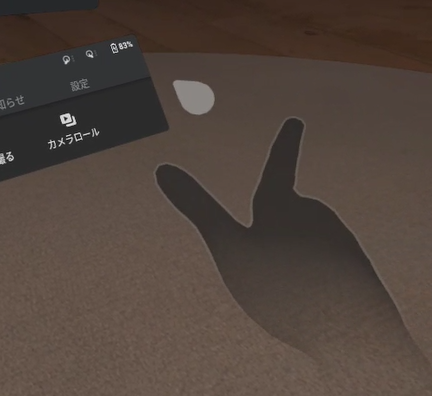

手のメニューデザインについて

手のメニュー表示についていろいろプロトタイプを作って実験した

CVはコンバージョンのことかな

Webサイトを見たユーザーが、Webサイト運営側の意図した行動を起こしてくれること

左手首に表示されて右手で選ぶものは難しかった(?)

片手で選ぶものの案を考えた(?)

片手で選ぶもの

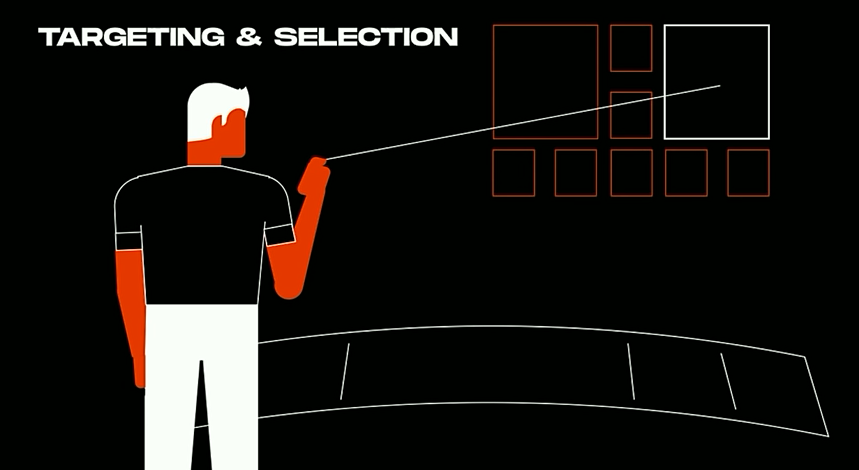

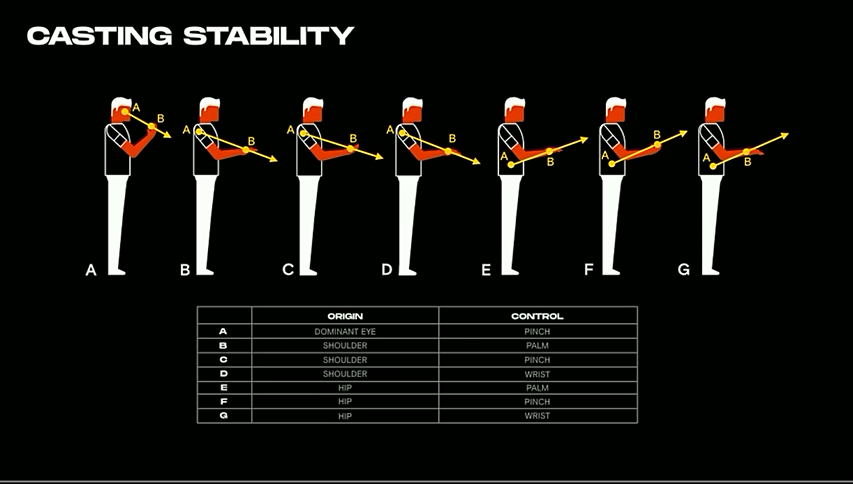

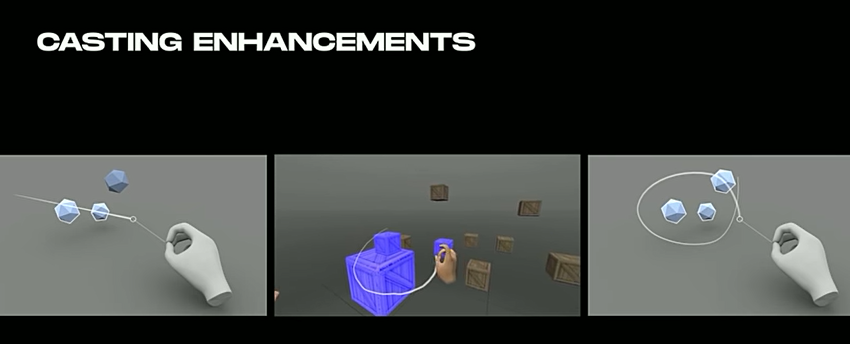

遠くのUIを選ぶ動作について(たぶん)

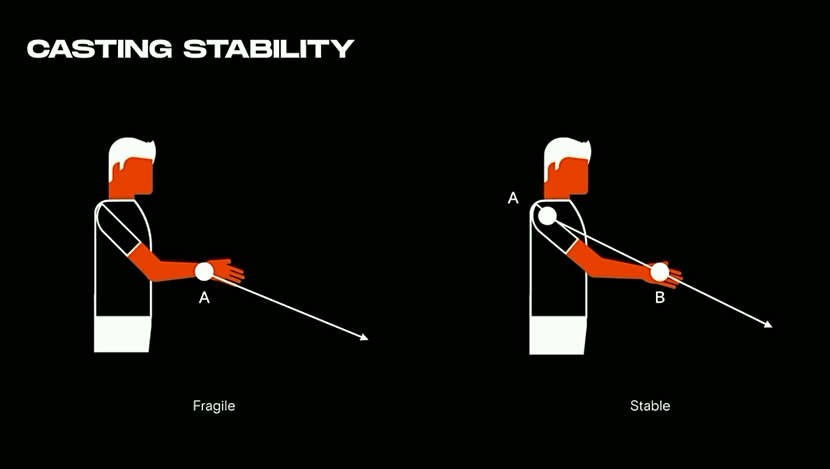

2点で支えると安定する?

fragile=もろい

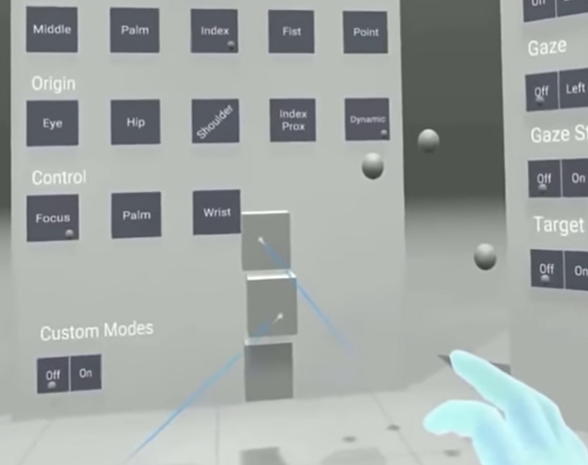

いろいろな組み合わせでものを選択するという動作をした

Palm=手のひら

Pinch=つまむ

Wrist=手首

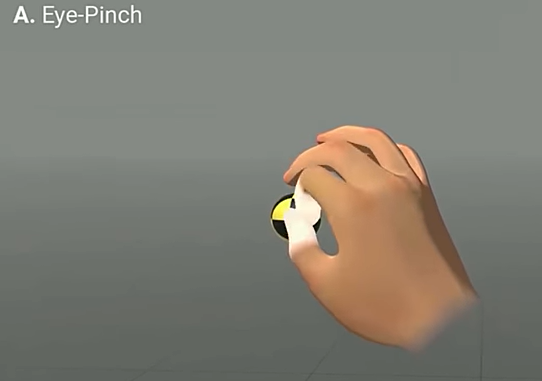

Aは目で見て手で直接選ぶ

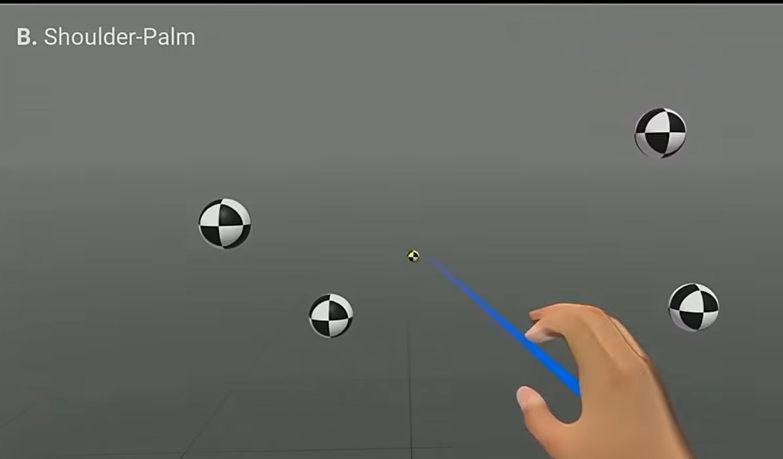

Bは手のひらからレーザーが出てる

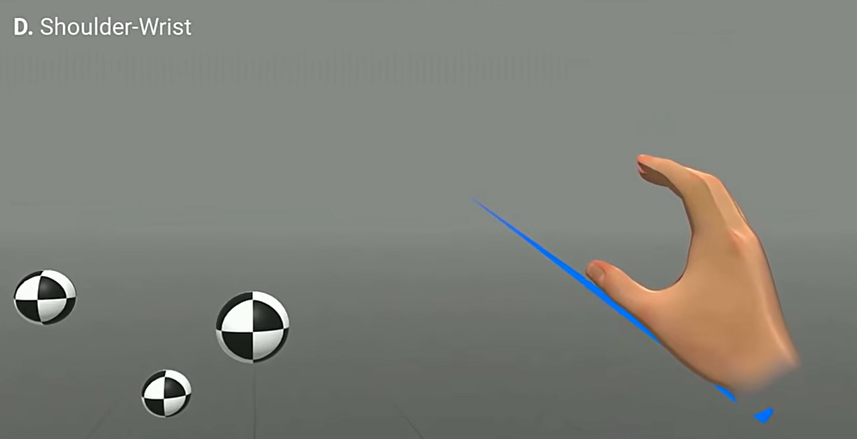

Dは手首からレーザーが出てる。

(Pinchがどこからレーザー出るのかよくわからない。あと肩とかおしりからの角度ってどうやってとっているのか?よくわからない)

結局頭の向きによってレーザーを出す方向を変えた(たぶん)

上を見ているときはおしりから出して、下を見ているときは肩から出す。

左右も同じく

ーーーーーーーーーーーーーーーーーーーーーーーーーーー

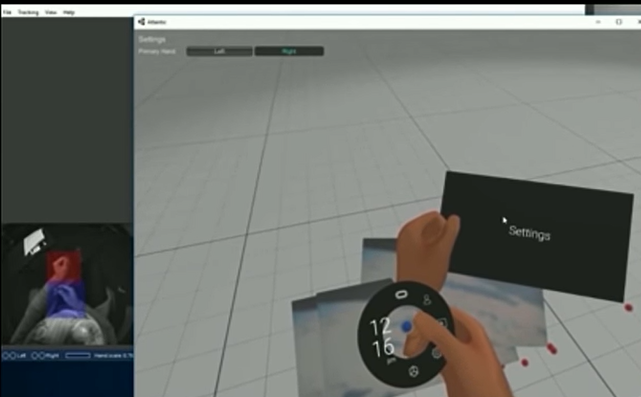

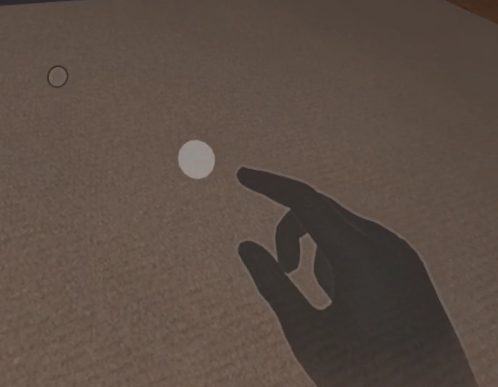

Questで確認した。

下を見た状態で手を出すとカーソルが下に向いてて、

上を見た状態で手を出すとカーソルが上に出る・・・気がする

左右はよくわからなかった。いまいちどの角度から出てるのか分からない。

ーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーー

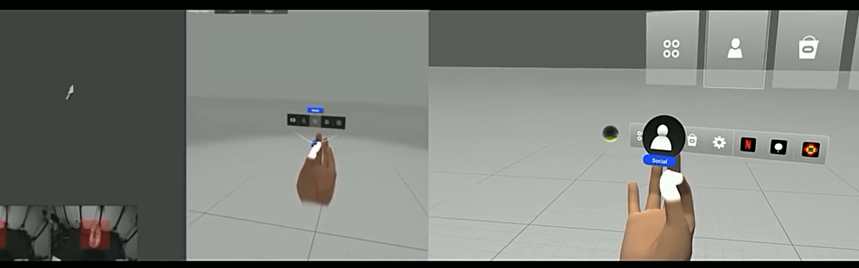

片手で空間のものを複数選ぶUI

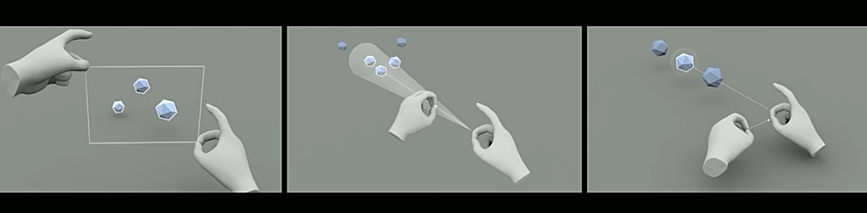

両手を使った場合の話

両手を使って3次元のインタラクションしたら分かりやすい。

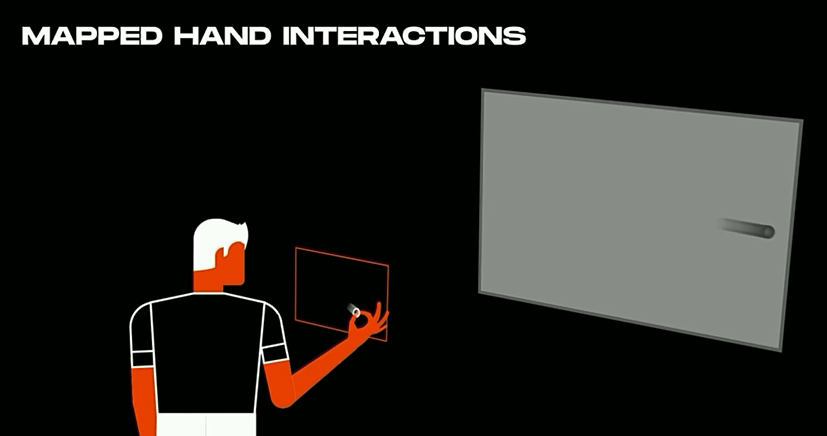

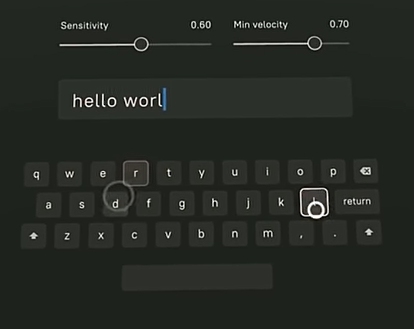

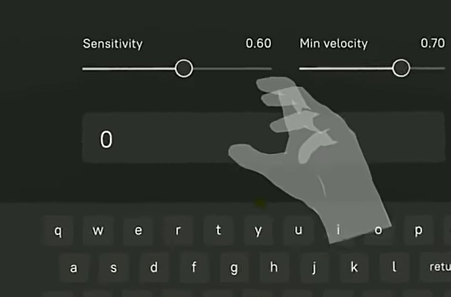

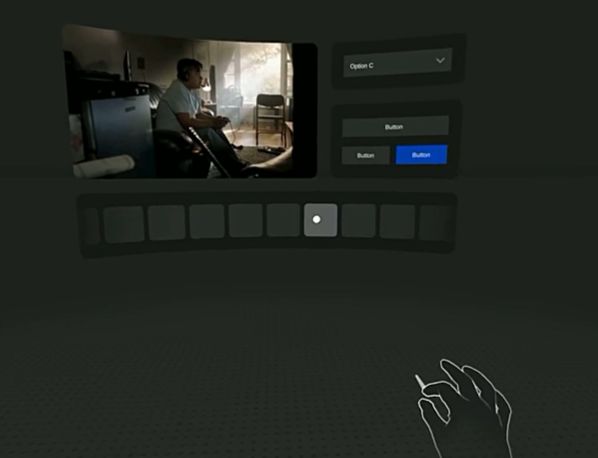

手元でのインタラクションを遠く(手を伸ばさない範囲)のUIに反映する話

手元でどれくらい動かしたときに、UI側のポインタをどれくらい動かすか。スピードや加速度を調整

位置、回転、スケールをそれぞれどのくらいのパラメーターで動かすか

マッピングは複雑さと経済的負担(economic strain)を減らす?

ハンドトラッキングでのフィードバックについて

ハンドトラッキングでのフィードバックは、

自分(自分の指同士が触れた場合)、視覚、聴覚

ピンチ(つまむ)動作はポテンシャルがある

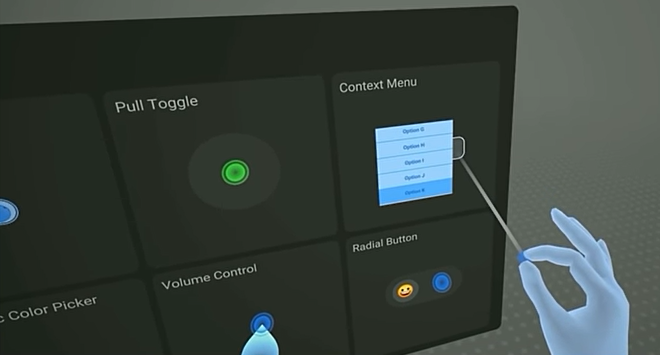

メニュー選択

色選択

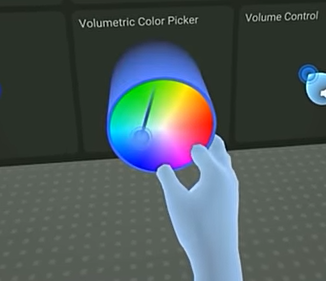

3次元の色選択

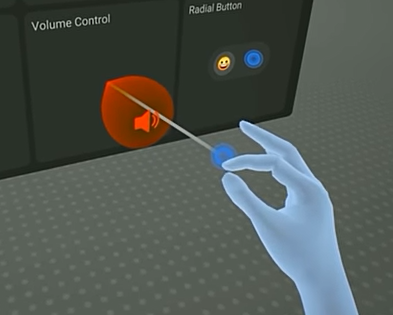

音量ボリュームもコンパクトに!

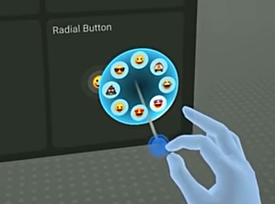

絵文字

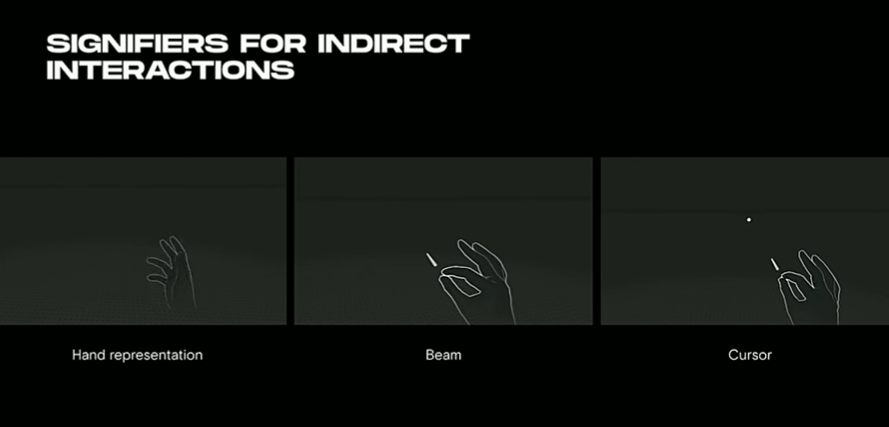

間接的なインタラクション

選択、決定

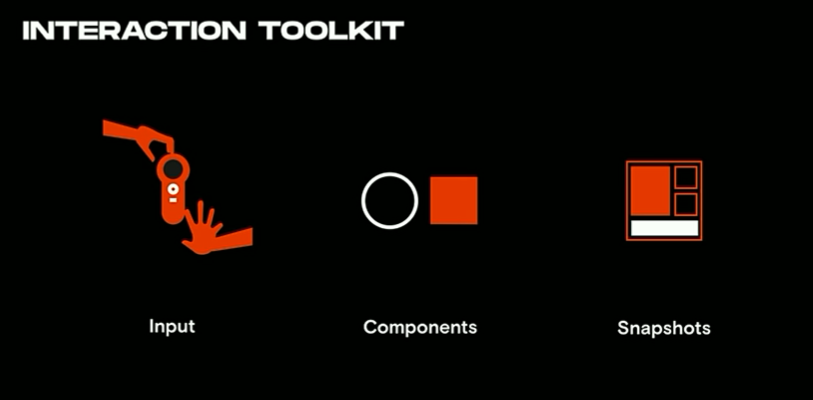

Creating Building Blocks

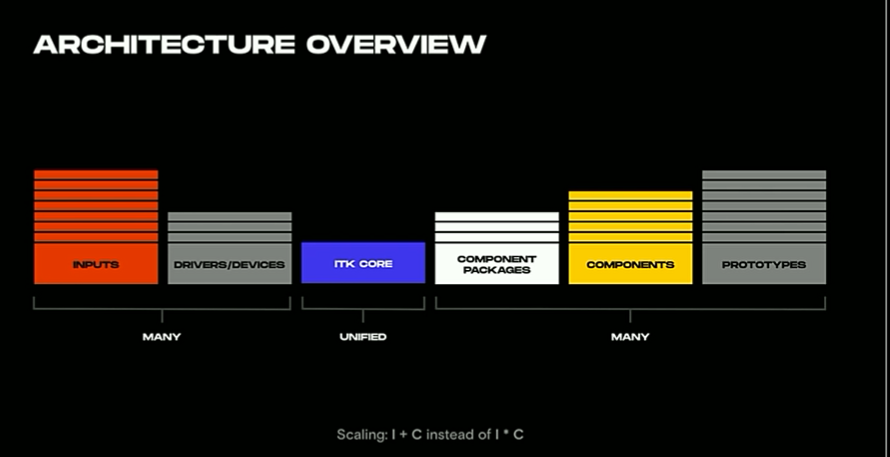

インプットの方法はいっぱいある?

(ITK COREってなんだ?)

上のほうで出た肩やおしりからのレーザー切り替えができるプロトタイプ

椅子に座ってデザインしたら自分にピッタリなデザインはできる。

でも人間の手はみんなちがう。

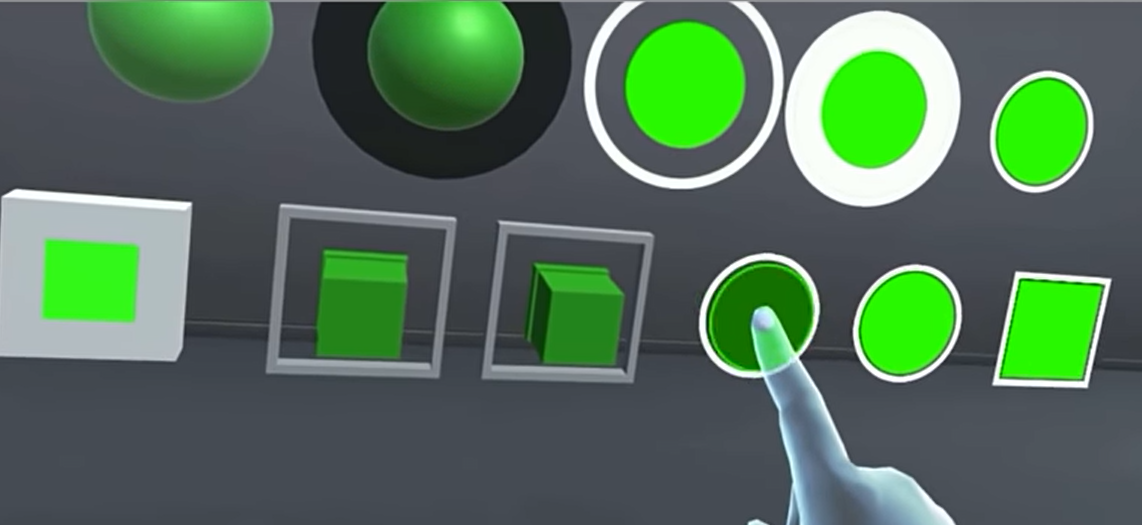

ボタンを押したときのボタンの変化によるフィードバックはどれがいいか(アフォーダンス)

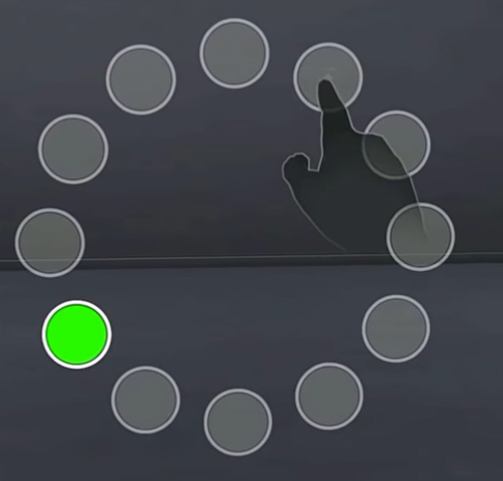

ボタンを押すテスト

ダイレクトとインダイレクト

次のボタンを押すスピードとか゚正確率もとっている?

Questのホーム画面の形でもテストしてる

ガイドラインを発行するよ

いっぱい研究したけどまだすべては分かってない

コメント欄

この動画のコメント欄に書いてあったこと

・"Every person is an expert in using their own hand." Got you.

・(コントローラーの)バッテリーがいらなくなる!

・指が欠損している人はどう表示されるの?

親戚も指がないからどうなるか気になる。義手でも反応するのかとか。